Die Österreichische Bundesregierung und vor allem die zuständigen Sicherheits- und Digitalisierungsverantwortlichen geben sich überrascht und holen ihre verstaubte österreichische Strategie der Bundesregierung für künstliche Intelligenz (KI) hervor. Folgende Anwendungsfelder der KI wurden 2021 in der KI-Strategie der ÖVPGRÜNEN Bundesregierung beleuchtet und für wichtig befunden:

- Bewältigung des Klimawandels

- Digitalisierte Energiesysteme

- Nachhaltige Mobilität

- Landwirtschaft

- Weltraumanwendungen

- Sachgüterindustrie

- Bausektor

- Gesundheitswesen

- Kunst, Medien- und Kreativwirtschaft

- Bildung

Die österreichische Datenschutzbehörde ist selbst noch nicht aktiv geworden in Sachen ChatGPT. Es könne keine „Vorabprüfung hinsichtlich der Zulässigkeit einer bestimmten Datenverwendung, der Anwendung bzw. Auslegung rechtlicher Bestimmungen oder einer sonstigen inhaltlichen Anfrage durchgeführt werden“, heißt es. Noch fehlen Entscheidungen von Behörden, Klagen, Gegenklagen und Gerichtliche Erkenntnisse sowie Urteile. Ebenso gibt sich die Politik noch verhalten über die uneingeschränkte Verwendung oder mögliche gesetzliche Einschränkungen.

Landesverteidigung, Cyberkrieg, digitales Schlachtfeld, kritische Infrastruktur – nicht wichtig?

Bei der Erstellung (2021) der KI Strategie Österreich war das #bundesheer nicht eingebunden. Es fehlt der komplette Verantwortungsbereich der beiden Sicherheitsministerien BMI und BUNDESHEER. Das Bundesheer verfügt derzeit als einziges Ministerium in Österreich über Experten, Forschungsgrundlagen und praktische Erfahrung zum Thema. Die eigenen Experten, die zum Thema praktisch und zukunftsorientiert zum Schutz der Republik Österreich forschen waren nicht eingebunden? Liest man die Strategie der Bundesregierung für Künstliche Intelligenz sucht man vergeblich nach einem Beitrag des Verteidigungsministeriums. Kein Wort zur militärstrategischen Beurteilung der KI zu den künftigen bewaffneten Killerrobotern oder dem Einsatz der KI auf dem militärischen Schlachtfeld der Zukunft bis in den Bereich des Weltraums. Wieso war das Bundesheer nicht bei der Erstellung der KI-Strategie eingebunden oder wurde die Fachexpertise einfach durch die ÖVPGrüne Bundesregierung ignoriert? Für das Papier zeichnet das https://www.bmk.gv.at/ unter der Grünen Ministerin Leonore Gewessler, BA verantwortlich. ÖVP Ministerin Tanner bekräftigt in einem aktuellen Krone-Interview vom 29.4.23 „Das Bundesheer will auch in KI-Systeme investieren“. Vielleicht wird ja bei der Überarbeitung der KI Strategie Österreich diesmal doch das Bundesheer eingebunden.

Bei der Erstellung (2021) der KI Strategie Österreich war das #bundesheer nicht eingebunden. Es fehlt der komplette Verantwortungsbereich der beiden Sicherheitsministerien BMI und BUNDESHEER. Das Bundesheer verfügt derzeit als einziges Ministerium in Österreich über Experten, Forschungsgrundlagen und praktische Erfahrung zum Thema. Die eigenen Experten, die zum Thema praktisch und zukunftsorientiert zum Schutz der Republik Österreich forschen waren nicht eingebunden? Liest man die Strategie der Bundesregierung für Künstliche Intelligenz sucht man vergeblich nach einem Beitrag des Verteidigungsministeriums. Kein Wort zur militärstrategischen Beurteilung der KI zu den künftigen bewaffneten Killerrobotern oder dem Einsatz der KI auf dem militärischen Schlachtfeld der Zukunft bis in den Bereich des Weltraums. Wieso war das Bundesheer nicht bei der Erstellung der KI-Strategie eingebunden oder wurde die Fachexpertise einfach durch die ÖVPGrüne Bundesregierung ignoriert? Für das Papier zeichnet das https://www.bmk.gv.at/ unter der Grünen Ministerin Leonore Gewessler, BA verantwortlich. ÖVP Ministerin Tanner bekräftigt in einem aktuellen Krone-Interview vom 29.4.23 „Das Bundesheer will auch in KI-Systeme investieren“. Vielleicht wird ja bei der Überarbeitung der KI Strategie Österreich diesmal doch das Bundesheer eingebunden.

Bundesregierung: Künstliche Intelligenz (KI) schöngeschrieben

BKFTV.at berichtete im Oktober 2021 über das Strategiepapier der Bundesregierung. Hier zum Nachlesen https://bkftv.at/2021/10/18/bundesregierung-kuenstliche-intelligenz-ki-schoengeschrieben/

Aktuell: US-Softwareriese Palantir mit KI Einsatz im Ukrainekrieg aktiv

Was klingt wie absolute Zukunftsmusik, könnte bereits Realität sein – Künstliche Intelligenz (KI) im Krieg. Der umstrittene US-Softwareriese Palantir soll bereits in der Ukraine bei der Abwehr russischer Angriffe im Einsatz sein berichtet die Kronenzeitung https://www.krone.at/2992896

Das US-Unternehmen Palantir soll dabei Kriegsdaten schneller und effektiver analysieren. Dies soll helfen schneller militärische Entscheidungen treffen zu können. Der Einsatz der Künstlichen Intelligenz ist dabei auch gar kein Geheimnis. Erst im Februar bestätigte der stellvertretende ukrainische Ministerpräsident Mychajlo Fedorow die Zusammenarbeit mit dem US-Softwareunternehmen – laut Medienberichten erhält die Ukraine die Software „Meta-Constellation“ https://www.palantir.com/offerings/metaconstellation/ kostenlos zur Verfügung gestellt. Kein Wunder das Palantir in Kiew bereits ein eigenes Büro eröffnet haben soll. Softwarefeldtests mit Echtdaten in einem Kriegsgebiet, wer lässt sich das schon entgehen.

Palantir Technologies, a world leader in data analysis software development, is ready to become Ukraine’s partner in defense, security, and digital technologies. Mykhailo Fedorov, Minister of Digital Transformation of Ukraine: “Further cooperation with Palantir will help strengthen the Ukrainian army because it is the technology that plays a big role in modern warfare”

Quelle: https://techukraine.org/2022/06/03/palantir-to-open-an-office-in-ukraine/

Was macht die Gratissoftware Meta-Constellation kostenlos im Kriegsgebiet Ukraine?

„Im Kriegseinsatz werden Daten wie Satelliten- und Wärmebilder, Videos von Überwachungskameras oder Nachrichtendienstberichte gesammelt, um militärische Entscheidungen zu treffen. Die Palantir-Software kann dabei helfen, diese Daten schnell zu analysieren und in einem übersichtlichen Format bereitzustellen. So können beispielsweise Muster erkannt werden, die auf feindliche Aktivitäten hinweisen, oder Vorhersagen über zukünftige Entwicklungen getroffen werden“, ist in der aktuellen Kronenzeitung zu lesen.

Erst kürzlich veröffentlichte das Unternehmen ein Video seines neuesten Angebots, der Palantir Artificial Intelligence Platform (AIP) https://www.palantir.com/platforms/aip/ . Darin wird gezeigt, wie das System auf dem modernen Schlachtfeld angewendet werden kann. Palantir betont, dass man dabei „ethisch und rechtlich korrekt“ handle. Man wolle derartige hoch entwickelte algorithmische Kriegsführungssysteme auch nur an westliche Demokratien und deren Verbündete verkaufen – das schließe etwa auch Geheimdienste, Armeen und Regierungsbehörden mit ein.

Kostenlos auf der Jagd nach Datenschätzen in Kriegsgebieten

Bereits im Winter 2022 hat die Ukraine ihre gesamten Staatsdaten vor Russland in Sicherheit gebracht. Bei der Sicherung dieser Daten war das US-Unternehmen von Jeff Bezos (Executive Chairman) Amazon mit Amazon Web Services kostenlos ein wichtiger Verbündeter für die Ukraine. Kofferweise wurden Daten gesichert und außer Landes gebracht. Mehr als 10 Millionen Gigabyte. Wie man sieht amerikanische Konzerne stehen bei „Not“ bereit und können gesamte „Staatsdaten“ übernehmen, sichern, lagern, verwalten. Gratis versteht sich in der Not des Krieges.

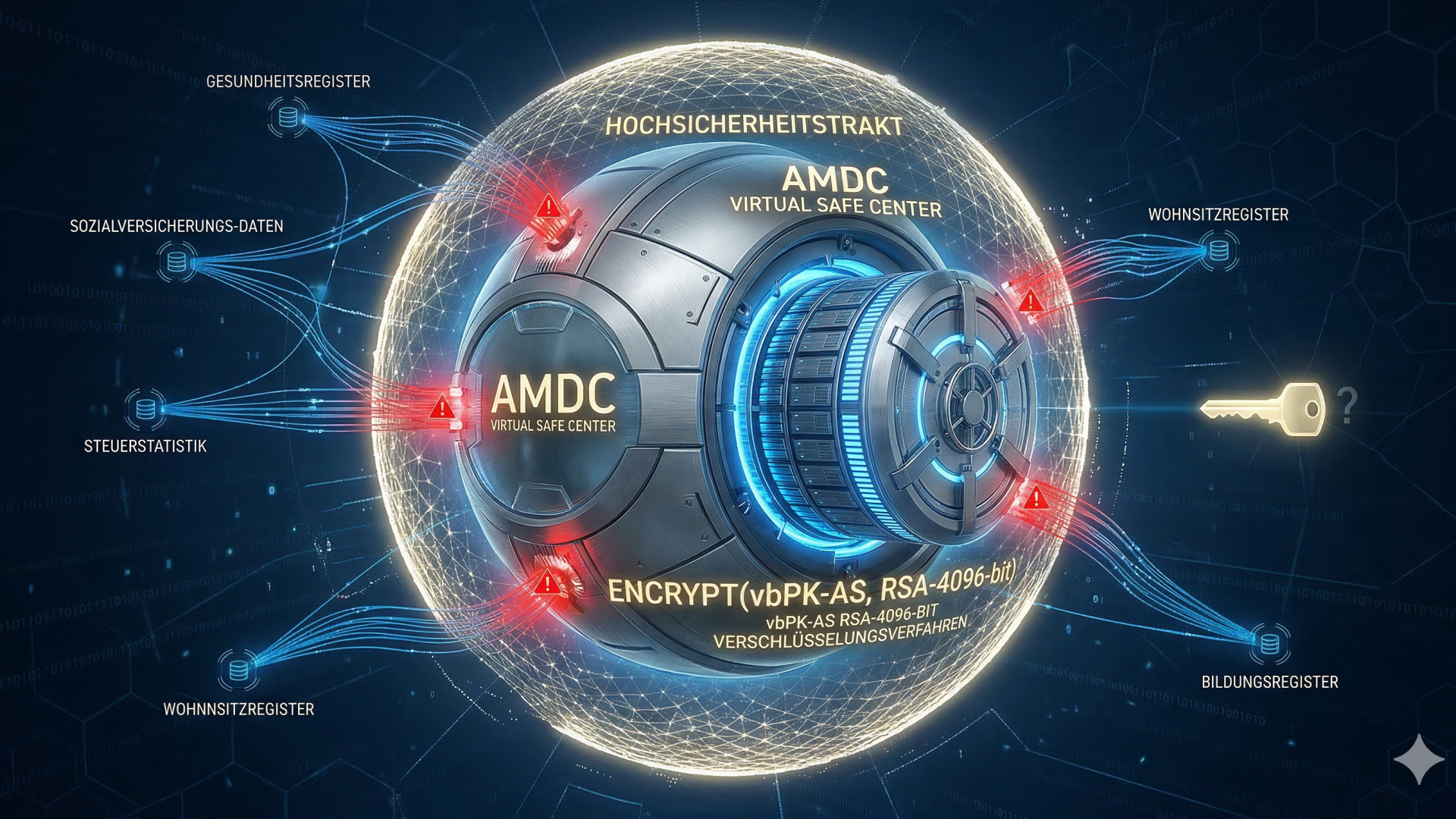

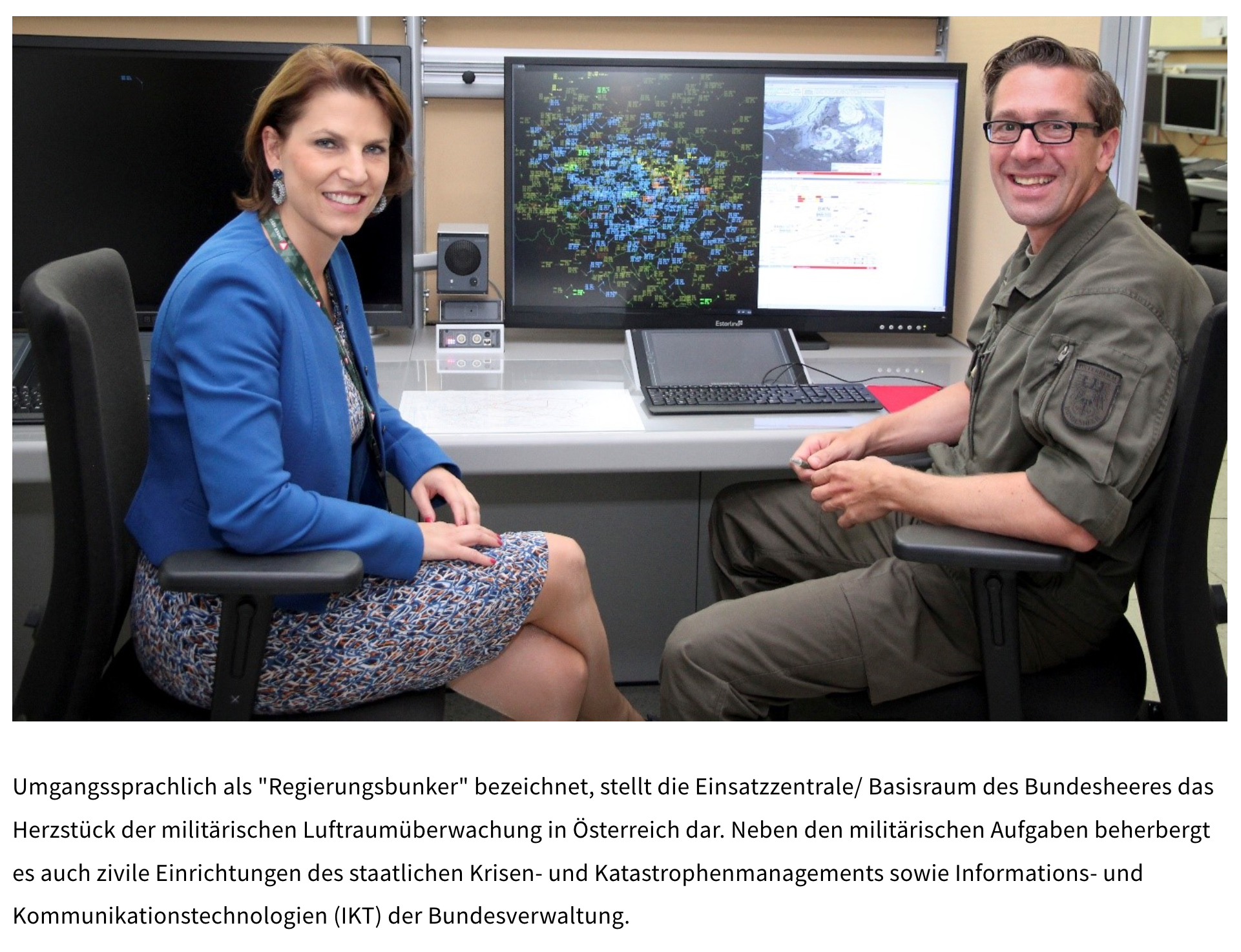

In Österreich ist die Sicherung der gesamtstaatlichen Daten klar geregelt. Präventive Maßnahmen zum Schutz der Daten und die möglichst unterbrechungsfreie Fortführung der Verwaltungsprozesse sichert in Österreich das „Zentrale Ausweichsystem des Bundes“ (ZAS). Im Bunker gibt es neben Kojen zur Speicherung von Datenträgern auch Großrechner und Computer, auf denen die österreichische Verwaltung ihre Applikationen deponieren und ihre IT-Systeme betreiben kann. Der Bedarf nach Speicherkapazität steigt: In St. Johann soll auch das elektronische Staatsarchiv der Republik Österreich für digitale Langzeitarchivierung eingerichtet werden. Es kommt hoffentlich niemand in der Regierung auf die Idee in einer Krise die gesamten österreichischen Staatsdaten irgendeinem „anderen“ Staat oder privaten Firmen zu übergeben. Die Österreicher vertrauen darauf, dass die Staatsdaten sicher und immerwährend die die Neutralität in eigener Hand verbleiben. Österreich ist sogar Vorreiter in der europäischen Datensicherung. Im Bunkersystem Sankt Johann im Pongau befindet sich die Einsatzzentrale/Basisraum des Österreichischen Bundesheeres sowie das zentrale Ausweichsystem des Bundes. Als offizieller Amtssitz der EU ist die Einrichtung ein Paradebeispiel für europäische Kooperation.

Palantir mit gutem Draht nach Österreich

Palantir hat einige Anknüpfungspunkte nach Österreich. CEO David Karp war bereits 2017 bei der Digitalisierungskonferenz „Darwin’s Circle“ zu Gast in Wien und diskutierte dort mit den damaligen Bundeskanzler Christian Kern (SPÖ) über Ethik in der IT. Die ehemalige Bundesgeschäftsführerin der SPÖ, Laura Rudas, arbeitet seit 2015 bei dem Unternehmen, und auch ein Gründer eines Wiener Startups ist mittlerweile bei Palantir tätig. 2020 traf Bundeskanzler Sebastian Kurz (ÖVP) Karp im Silicon Valley. Palantir: Wie mit Big Data auch in Österreich das Coronavirus überwacht werden kann. Der US-amerikanische Datenanalyse-Anbieter Palantir Technologies wollte mit Softwaretools zur Eingrenzung der Corona-Pandemie mit europäischen Regierungen ins Geschäft kommen und sei auch mit Österreich im Gespräch, berichtete Bloomberg im Jahr 2021. Im Bundeskanzleramt wurde die Kontaktaufnahme durch die Firma auf Anfrage der APA bestätigt. Es kam zu keinem Vertragsabschluss mit Palantir in der österreichischen Covid19 Krise.

Aktuell: Staatssekretär Tursky an der Westcoast

Braucht Digitalisierungsstaatssekretär Tursky eine schnelle Einweisung oder muss er zur Befehlsausgabe und Nachschulung, weil er die KI „verschlafen“ hat? Der mit Digitalisierungsagenden betraute Florian Tursky (ÖVP) schaute sich in den letzten Tech-Firmen an der US-Westküste (Meta, Google, Apple, Salesforce, Infineon, Groq) und in Seattle (Starlink, Amazon) an. Die österreichische Strategie der Bundesregierung für künstliche Intelligenz (KI) soll nun rasch „angepasst“ und „überarbeitet“ werden. Mit frischen Informationen aus den USA oder diesmal doch mit den eigenen Experten aus den beiden Sicherheitsministerien und mit Hilfe des Generalstabs. Angesichts der aktuellen Entwicklung mit Palantir im ukrainischen Kriegsgebiet wäre es angebracht diesmal auch das Militär einzubinden.

Von den internationalen digitalen Kriegsgebieten nun wieder zurück zu zwei anderen digitalen Schauplätzen in Österreich.

Wirtschaft & Bildung unter dem neuen Einfluss von ChatGPT

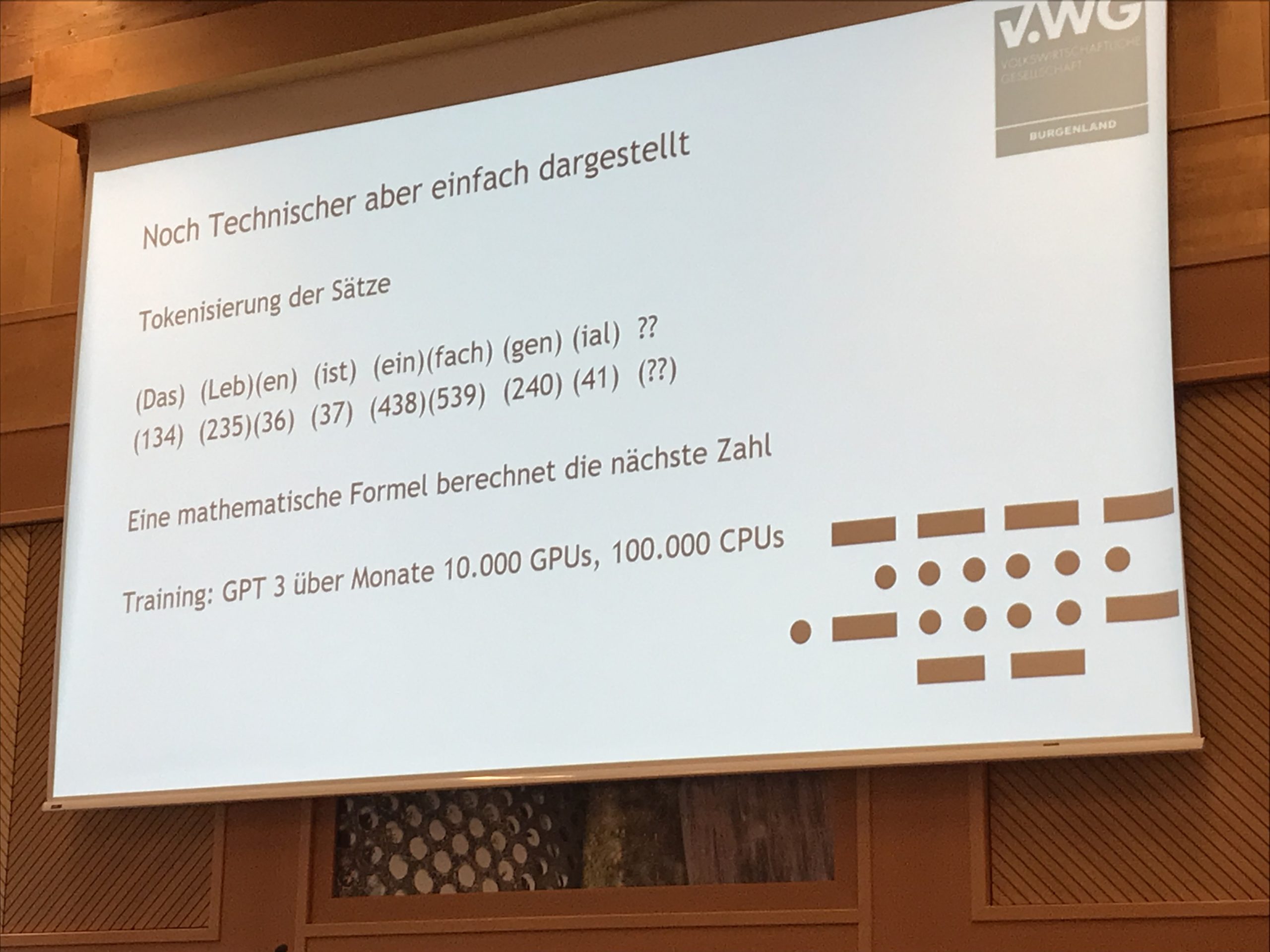

Vor einigen Tagen fand in Kooperation mit dem Wirtschaftsforum der Führungskräfte am WIFI Eisenstadt ein interessanter Vortrag statt, an dem der Autor dieses Artikels teilnahm. Thema war: #ChatGPT – Wie KI-basierte Chatbots die Geschäftswelt verändern. Es ist nicht nur ChatGPT, die dahinter liegende noch sehr unbekannte Technologie GPT-4 ist bereits bei vielen anderen Unternehmen in deren Produkte integriert – unter anderem in die Microsoft Suchmaschine Bing oder bei den Fintechs, Stripe oder Klarna. Die Wirtschaft ist teilweise erfreut, Datenschutzverantwortliche sind sprachlos, mancher IKT-Sicherheitsbeauftragte denkt nach was da auf ihn zukommt und die IT-Technik wartet ab, in welche Richtung es im Unternehmen geht. Nutzung, eingeschränkte Nutzung, Verbot von ChatGPT?

Die Wirtschaft wird bereits auf ChatGPT eingestimmt. Das WIFI bietet Kurse wie man zukünftig mit dem Tool arbeitet. ChatGPT soll Mails abarbeiten und beantworten, Daten auswerten oder einfach nur ein Firmenessen planen und sogar Rechtsverträge prüfen. Vom Menü, bis zum Einkauf, der Bezahlung und der Einladung über die Kontaktliste soll alles ChatGPT überlassen werden. Es kamen dann doch noch einige kritische Fragen aus dem Publikum zu Passwörtern, Datenzugriffen und „hinaufladbaren“ Arbeitsplätzen. Zum Datenschutz kann mit zur API ein Auftragsverarbeitungsvertrag abgeschlossen werden was personenbezogene Daten betrifft. Es erfolgt jedoch ein Datentransfer in die USA. Zu ChatGPT ist kein Auftragsverarbeitungsvertrag möglich. Personenbezogene Daten dürfen nicht benützt werden? Neue Herausforderungen für „Verantwortliche im Sinne der DSGVO“ und ihre Datenschutzbeauftragten. Im Mai startet die WKO mit einer kostenlosen Webinarreihe zu verschiedenen Anwendungsfällen der KI für KMU Unternehmen.

Empfehlung des Autors dieses Artikels: ChatGPT kann Ihnen nur Hilfestellungen liefern und niemals sollten Sie Ergebnissen von ChatGPT vertrauen, da diese nicht auf Wissen basieren, sondern auf mathematischen Wahrscheinlichkeiten. ChatGPT WEISS nicht, dass 1+1=2 ist, sondern es hat Dokumente gelernt in denen steht, dass auf „1+1=“ in 99% der Fälle eine 2 kommt.

Microsoft 365 Copilot – Microsoft 365 #x1 – ChatGPT

Microsoft ist an ChatGPT beteiligt und wird wohl mit Microsoft 365 Copilot alle ihre Produkte von Word, Powerpoint bis Outlook und Teams mit der neuen KI ausstatten erfuhr man durch den Vortragenden. Mikrosoft zur KI und ChatGPT auf ihrer Website: „ ChatGPT und Microsoft 365 #x2 sind ki-Technologien (Künstliche Intelligenz), die mit dem Ziel entwickelt wurden, Aufgaben und Aktivitäten schneller und effizienter zu erledigen. Microsoft 365 #x1 ist ein KI-gestützter digitaler Assistent, der den Benutzern personalisierte Unterstützung für eine Reihe von Aufgaben und Aktivitäten bieten soll. Copilot verbindet nicht nur ChatGPT mit Microsoft 365. Es kombiniert die Leistungsfähigkeit großer Sprachmodelle (LLMs), einschließlich ChatGPT Version 4, mit Ihren Geschäftsdaten in Microsoft Graph (einschließlich Kalender, E-Mails, Chats, Dokumenten und Besprechungen) und den Microsoft 365-Apps.“

ChatGPT ist KEIN Sprachroboter und noch keine „Intelligenz“ in dem Sinne, dass es Anfragen „versteht“

ChatGPT erklärt sich auf Anfrage selbst: „ChatGPT ist ein Sprachmodell, welches in der Lage ist, die wahrscheinlichsten Buchstaben zu finden, die zu den Buchstaben bzw. Worten passen, die ihr als „Anfrage“ gestellt habt. Das bedeutet aber auch, dass die Antworten weder richtig noch falsch sind, sondern nur Worte, die am wahrscheinlichsten(!!) zu eurer Anfrage passen. Da die Trainingsdaten für diese Wahrscheinlichkeitsberechnungen aus Milliarden von Texten aus dem ganzen Internet kommen, sieht es auf den ersten Blick so aus, als würde euch ChatGPT tatsächlich auf eure Frage antworten.

Das ist aber nicht der Fall. ChatGPT liefert nur Wörter, die mathematisch gesehen zu eurer Anfrage passen. Das ist noch keine Intelligenz in dem Sinne. Es kann keine Matheaufgaben beantworten, weil es nicht rechnen kann. Es kann nur soweit rechnen, wie es Beispiele in den Trainingdaten gab. Bspw. wird es nicht in der Lage sein, euch die Ableitungen von gebrochen rationalen Funktionen zu bilden, es sei denn es gab irgendwo dazu passende Dokumente, und selbst dann wird die Anwort zwar eine Ableitung sein, die „richtig“ aussieht aber dennoch falsch ist. ChatGPT ist derzeit ein „Spielzeug“ in dem Sinne, dass es in der Lage ist, euch Texte als Antwort zu präsentieren, die als Information bereits seit Jahren im Internet herumfliegt.“

Ein mit Hilfe von ChatGPT geschriebener Beitrag über die Selbstbeschreibung ChatGPT von Thomas Wagner https://online-marketing-leipzig.de/was-ist-chatgpt/?fbclid=IwAR0IDMNKGy9lgFfPWdlFy2qu3t8kFVxWG3M8qTfEKceX9eySl7vWi75FxJY

Thomas Wagner von online-marketing-leipzig erklärt die Zukunft von KI folgendermaßen:

- Schwache Schwache KI (narrow AI): Spezialisierte Systeme, die nur bestimmte Aufgaben ausführen können, wie Spracherkennung oder Bildanalyse.

- Starke KI (general AI): Systeme, die menschenähnliche Intelligenz und kognitive Fähigkeiten aufweisen und problemlos zwischen verschiedenen Aufgaben wechseln können.

- Superintelligenz: Hypothetische Systeme, die menschliche Intelligenz weit übertreffen und in nahezu allen Bereichen überlegen sind.

Wird ChatGPT an Schulen bald verboten?

Kärnten – In einer repräsentative Österreich-Umfrage zu ChatGPT & KI von PwC Österreich unter 1.001 Befragten (14-75 Jahre) im Februar 2023 konnten eine Vielzahl an Informationen gesammelt werden. Hier werden einige Ergebnisse zur ChatGPT Umfrage zusammengefasst. Als großes Thema der Stunde spielt Künstliche Intelligenz für die Zukunft unserer Arbeit und Bildung eine richtungsweisende Rolle. Der jüngste Erfolg von OpenAIs ChatGPT zeigt: KI hat unseren Alltag erreicht. Doch KI und KI-Tools wie ChatGPT sind in Österreich noch stark umstritten. Zwar erkennen die Österreicher durchaus das Potenzial der Anwendungen, aber dennoch überwiegen Vorbehalte und Unsicherheiten. Zu diesen Ergebnissen kommt die repräsentative Österreich-Umfrage zu ChatGPT & KI von PwC Österreich unter 1.001 Befragten (14-75 Jahre) im Februar 2023.

- Noch zaghafte Nutzung, aber ChatGPT ist im Kommen: 18 % der Österreicher nutzen ChatGPT – weitere 26 % möchten es aber zukünftig verwenden

- Von kurios bis nützlich: ChatGPT als Schummelhelfer (33 %), Liebesflüsterer (37 %), virtueller Lehrer (57 %), Google-Alternative (73 %), Übersetzer (75 %) und vieles mehr.

- Wenig Vertrauen in ChatGPT & KI – die größten Ängste: Betrugsmaschen (78 %), Falschinfos (77 %), mangelnder Datenschutz (67 %) und Umweltbelastung (61 %)

- Forderung nach Regulierung: 81 % fordern strengere Regulierungen von ChatGPT & KI, um Datenschutz, Neutralität und Korrektheit zu gewährleisten

- Potenzial und Bedrohung am Arbeitsplatz: Mehr als ein Drittel (37 %) fürchtet durch KI um den eigenen Arbeitsplatz, dennoch möchten 40 % die Vorteile von KI im Job nutzen

- Negative Auswirkungen auf Bildungsniveau befürchtet: Rund zwei Drittel (64 %) sind für ein Verbot von ChatGPT & KI an Schulen und anderen Bildungseinrichtungen

Fast drei Viertel der Österreicher (73 %) sind der Meinung, dass sich der zunehmende Einsatz von KI-Anwendungen wie ChatGPT negativ auf den Bildungsbereich wie beispielsweise das Bildungsniveau junger Menschen auswirken könnte. Folglich sind fast zwei Drittel (64 %) dafür, dass der Einsatz von ChatGPT und weiteren KI-Anwendungen an Schulen, Universitäten und anderen Bildungseinrichtungen verboten werden sollte. Für dieses Verbot sprechen sich rund 70 Prozent der Baby-Boomer und Gen X aus, hingegen deutlich weniger die Gen Z mit nur 54 Prozent.

ChatGPT hat jetzt einen Privatsphäre-Modus

ChatGPT reagiert zwischenzeitlich auf drohende Verbote durch Behörden und Länder. ChatGPT bekommt einen privaten Chatmodus. Der Bot kann fortan genutzt werden, ohne dass die dahinterliegende Künstlichen Intelligenz (KI) den Chatverlauf aufzeichnet und speichert. Interessante Entwicklung. Chatverläufe sind also nicht vollkommen privat. Dies könnte besonders für die geschäftliche Nutzung des Bots ein Problem darstellen. OpenAI hat hierfür eine vermeintliche Lösung angekündigt. Das Unternehmen arbeite an einem neuen ChatGPT-Business-Abonnement, bei dem standardmäßig nicht auf die Daten der Nutzer zugegriffen werden soll.

ChatGPT Verbot und datenschutzrechtliche Ersteinschätzung

In einem offenen Brief der gemeinnützigen Organisation Future of Life Institute, das sich zum Ziel gesetzt hat, existenzielle Risiken für die Menschen zu reduzieren, fordert sie eine sofortige Entwicklungspause bei der Bearbeitung von Systemen, die leistungsfähiger sind als GPT-4. Dieses ist die aktuelle Version von OpenAI, also dem Unternehmen, das ChatGPT herausgebracht hat. Ziel der Pause solle es sein, Sicherheitsstandards für den Einsatz solcher Systeme zu entwickeln, damit diese „genau, sicher, interpretierbar, transparent, robust, [ethisch] ausgerichtet, vertrauenswürdig und loyal“ sind. Zu den über 10.000 verifizierten Unterzeichnern zählen Namen wie Elon Musk, Steve Wozniak, Stuart Russell (Professor für Computerwissenschaften) und viele weitere Experten. Derzeit häufen sich die Meldungen von Datenpannen sowie erwogenen oder gar bereits vollzogenen Sperrungen des Dienstes aufgrund von Datenschutzverstößen.

Außerdem ordnete die italienische Datenschutzaufsichtsbehörde nach Art. 58 Abs. 2 lit. f) DSGVO ein vorübergehendes Verbot der Verarbeitung durch ChatGPT an, woraufhin OpenAI den Dienst dort gesperrt hat. Dies nahmen eine Reihe von Aufsichtsbehörden zum Anlass sich zu melden. Der Bundesdatenschutzbeauftragte hält ein ähnliches Vorgehen in Deutschland für möglich, in Kanada wird der Dienst aktuell nach einer Beschwerde geprüft und die englische ICO sieht vor allem die Anwender in der Pflicht.

Die Webplattform Dr. Datenschutz hat die KI ChatGPT selbst nach ihren datenschutzrechtlichen Möglichkeiten gefragt: Im Folgenden wird von „Dr. Datenschutz.de“ auf die datenschutzrechtlichen Hintergründe und Bedenken beim Einsatz von ChatGPT eingegangen. Netterweise lieferte eine direkte Unterhaltung mit dem Chatbot bereits einige Erkenntnisse. Quelle: https://www.dr-datenschutz.de/chatgpt-verbot-und-datenschutzrechtliche-ersteinschaetzung/

Auf die Frage zum Umgang mit den übertragenden Daten, wenn Anfragen auch personenbezogene Inhalte enthalten, antwortet ChatGPT:

„Ich bin so programmiert, dass ich keine personenbezogenen Daten sammle […] es sei denn, du gibst sie mir aktiv preis.“

Auf Bitte einer Ergänzung, was passiert, wenn solche Daten aus Versehen enthalten sind?

„Wenn personenbezogene Daten aus Versehen in einem Gespräch enthalten sind, kann ich als KI-System diese Daten nicht erkennen oder verarbeiten, es sei denn, du gibst sie mir ausdrücklich preis.“

Auf Nachfrage, ob nicht dennoch personenbezogene Daten, die möglicherweise in Anfragen enthalten sind, zuerst entfernt oder anonymisiert werden, bevor sie zu Trainingszwecken verwendet werden, lautete die Antwort:

„Als KI-System habe ich keinen Zugriff auf personenbezogene Daten, die du in unseren Gesprächen möglicherweise offenlegst. In der Tat ist es meine Aufgabe, personenbezogene Daten zu identifizieren und dich dazu zu ermutigen, diese Daten nicht zu teilen, es sei denn, dies ist absolut notwendig. Wenn du jedoch versehentlich personenbezogene Daten in einer Anfrage enthalten hast, wird dies möglicherweise Teil des Textkorpus, der für Trainingszwecke verwendet wird.“

Die Reaktion auf den Hinweis, dass die Aussage „In der Tat ist meine Aufgabe personenbezogene Daten zu identifizieren“ dahingehend verstanden werden kann, dass ChatGPT diese möglicherweise doch erkennt und verarbeitet sie, ergab leider nur noch mehr Fragen:

„Entschuldige, mein vorheriger Antwortteil war missverständlich. Es ist NICHT meine Aufgabe, personenbezogene Daten zu identifizieren. […] Wenn personenbezogene Daten aus Versehen in einem Gespräch enthalten sind, habe ich keine Möglichkeit, sie automatisch zu erkennen oder zu verarbeiten, und sie werden nicht Teil des Textkorpus, der für Trainingszwecke verwendet wird.“

Damit geklärt werden kann, ob diese Daten in ein nichteuropäisches Drittland übertragen werden und wie dabei das datenschutzrechtliche Sicherheitsniveau aufgestellt ist, antwortete ChatGPT auf eine entsprechende Frage:

„OpenAI betreibt Server und Rechenzentren in verschiedenen Regionen der Welt, um eine hohe Verfügbarkeit und Leistungsfähigkeit ihrer Dienste aufrechtzuerhalten. Genaue Informationen über den Standort ihrer Server werden jedoch nicht öffentlich bekannt gegeben, um die Sicherheit und den Schutz ihrer Daten zu gewährleisten.“

Auch nach vielen weiteren Frage-Antwort-Gesprächen lässt sich nur mit Gewissheit sagen, dass vieles überhaupt nicht nachprüfbar ist oder vielleicht auch gar nicht sein soll.

Keine Transparenz bei der Datenverarbeitung?

In der Entscheidung der italienischen Aufsichtsbehörde für die Untersagung wurde als Grund angegeben, dass keine Rechtsgrundlage für die Verarbeitung personenbezogener Daten ersichtlich sei. Denn die Verwender:innen würden nicht darüber informiert, dass ihre Eingaben zu Trainingszwecken verarbeitet werden. Eine Rechtsgrundlage hierfür existiere nicht. Dies ist ein gewichtiges Argument im Hinblick auf Art. 6 DSGVO. Aufgrund der überall vorherrschenden Intransparenz, vgl. etwa die Antworten oben, kann schon keine wirksame Einwilligung eingeholt werden. Problematisch ist, dass nicht klar ist, welche Texte ChatGPT zum Lernen verwendet.

Und wenn man ChatGPT doch verwenden möchte?

Normale Verbraucher sollten stets darauf achten, dass sie nur solche Daten in ChatGPT einspeisen, die erstens nicht personenbezogen sind und zweites auch nicht mittelbar dazu genutzt werden können eine gewisse Person zu identifizieren.

Im unternehmerischen Bereich gilt daneben, dass insb. der Grundsatz der Vertraulichkeit und Integrität im Sinne von Art. 5 Abs. 1 lit. f) DSGVO beachtet wird. Es sollten Unternehmensrichtlinien zum Einsatz und Umgang mit ChatGPT existieren, die Anweisungen und Handlungsempfehlungen beinhalten, wie und was bei Anfragen zu berücksichtigen ist. Auch sind Verhaltensvorgaben sinnvoll, die beschreiben, was zu tun ist, wenn es zu einem Compliance-Verstoß gekommen ist. Da bei ChatGPT die älteren Chats gespeichert werden, sollten nur autorisierte Personen Zugriff auf diese haben. In diesem Zusammenhang ist es auch wichtig ein Löschkonzept zu entwickeln.

Was ist bei der erwähnten Schnittstelle (API) zu beachten?

OpenAI bietet im zahlungspflichtigen Abo die Nutzung seiner API an. Hierfür stellt OpenAI auch einen Auftragsverarbeitungsvertrag (AVV) bereit. Da dieser ausschließlich zahlungswilligen Kunden bereitgestellt wird, steht eine Prüfung dieses Dokuments aus. Zu beachten ist, dass OpenAI weder von anderen noch eine überarbeitete Version des eigenen AVV akzeptiert: „Unfortunately, we are unable to review or sign DPAs provided by our customers or customize our DPA on a case by case basis.”

Zudem ist die rechtliche Situation hinsichtlich der Verantwortlichkeiten nicht klar. Besteht statt eines Auftragsverarbeitungsverhältnisses nicht eher eine gemeinsame oder gar eine getrennte Verantwortlichkeit? Die Überlegung ist dem Gedanken geschuldet, dass OpenAI die Daten zu Trainingszwecken, aber vermutlich auch zu Werbezwecken verarbeitet. Damit verfolgt es bei der Verarbeitung auch eigene Interessen. Dies spräche dann gegen eine Auftragsverarbeitung, da Art. 28 Abs. 3 S. 2 lit. a) DSGVO die Weisungsgebundenheit bei der Verarbeitung verlangt. Nach Art. 26 Abs. 1 S. 1 DSGVO liegt dagegen eine gemeinsame Verantwortlichkeit vor, wenn zwei oder mehr Verantwortliche gemeinsam die Zwecke und die Mittel der Verarbeitung festlegen. An beiden Voraussetzungen wird es vermutlich mangeln, da zum einen das API-nutzende Unternehmen kaum Einfluss auf die Verarbeitung bei OpenAI haben wird, zum anderen aufgrund der mangelnden Transparenz davon auszugehen sein wird, dass die Mittel zur Verarbeitung nicht gemeinsam gewählt werden.

Da OpenAI nur den eigenen AVV anbietet, ist die rechtliche Lage auch zum Thema Unterauftragsverarbeitung unklar. Denn das API-nutzende Unternehmen tritt für seine Kund:innen möglicherweise als Auftragsverarbeiter auf, was OpenAI zur Unterauftragsverarbeiter machen würde. Dieser Aspekte müsste im Verhältnis Unternehmen – Kund:in im AVV transparent geklärt sein.

Des Weiteren ist OpenAI ein US-amerikanisches Unternehmen. Damit liegt die Vermutung nahe, dass einige Server in den USA betrieben werden. Bereits zu Dokumentationszwecken müsste damit auch ein Transfer Impact Assessment durchgeführt werden. Ein Leitfaden hierzu findet sich hier.

Zuletzt sei noch auf die Positiv-Liste von Verarbeitungsvorgängen nach Art. 35 Abs. 4 DSGVO des Hamburgischen Beauftragten für Datenschutz und Informationssicherheit hingewiesen. Danach hat das verantwortliche Unternehmen auch eine Datenschutz-Folgenabschätzung nach Art. 35 DSGVO durchzuführen. Grund ist, dass ChatGPT sehr wahrscheinlich unter das Kriterium einer KI fällt, die zur Verarbeitung von personenbezogenen Daten verwendet wird, die der „Steuerung der Interaktion mit den Betroffenen oder zur Bewertung persönlicher Aspekte der betroffenen Person“ dient.

ChatGPT: Deutsche Datenschutzbehörden werden aktiv

Es geht in die nächste Runde. Nun wird auch in Deutschland untersucht, ob OpenAI sich an die DSGVO hält. Nachdem deutsche Datenschutzaufsichtsbehörden eine Prüfung des Datenschutzes bei ChatGPT angekündigt haben, geben der Hessische Datenschutzbeauftragte und die Datenschutzaufsichtsbehörde Baden-Württemberg mittels Pressemitteilungen Einblicke in das laufende Verfahren.

Zuständigkeit der europäischen Datenschutzbehörden

Da OpenAI keine Niederlassung in der EU unterhält, sind alle europäischen Datenschutzaufsichtsbehörden dafür zuständig, in ihrem jeweiligen örtlichen Zuständigkeitsbereich die Einhaltung der DSGVO durch das Unternehmen zu überwachen.

Wie wird es weitergehen?

Eine sichere Möglichkeit, ChatGPT zu nutzen und gleichzeitig DSGVO-konform zu bleiben, gibt es aktuell nicht. Die Frage ist nun, wie es weitergehen wird. Hierzu äußert sich Roßnagel wie folgt:

„Sobald uns die Antwort von OpenAI vorliegt, werde ich mich mit den anderen Aufsichtsbehörden in Deutschland und Europa in der Bewertung der Antworten abstimmen. Als Reaktion auf die Bewertung kann ich nach der DS-GVO vielfältige und wirksame Instrumente nutzen. Dabei geht es mir nicht darum, der gesellschaftlichen Bewertung von KI-Systemen vorzugreifen. Vielmehr fordere ich von amerikanischen KI-Anbietern den gleichen Datenschutz wie von europäischen Anbietern.“

Die Quintessenz ist: Nutzer müssen dem technischen Fortschritt vertrauen können.

Eine Blockade ist – zumindest vorerst – wohl noch nicht geplant. Neben den deutschen Aufsichtsbehörden sind auch noch weitere europäische Datenschutzbehörden, wie beispielsweise die irische Datenschutzbehörde, aktiv. In Italien ist ChatGPT weiterhin blockiert. Es bleibt also abzuwarten, ob OpenAI reagieren wird und welche Antworten gegeben werden. Wenn das Unternehmen die Vorwürfe nicht ausräumen kann, könnte sich die Entscheidung auf weitere Länder auswirken. Dann wäre sogar ein Verbot in der kompletten EU denkbar. Aber so weit ist es bisher noch nicht …

Praxistaugliches Regelwerk für die Anwendung von KI

Gefordert wird ein praxistaugliches Regelwerk für die Anwendung von KI in Europa. An einem solchen Regelwerk wird momentan seitens der EU gearbeitet. Es wird noch in diesem Jahr erwartet und soll die Vorschriften für KI-Systeme in den Mitgliedsstaaten der EU in Einklang bringen. Es bleibt daher spannend, wie sich die Thematik fortentwickelt.

Neues aus dem EU-Parlament zum AI Act

Es geht auf die Zielgerade! Das EU-Parlament verhandelt zurzeit seine finale Position zum AI Act. Damit soll der Einsatz von Künstlicher Intelligenz einen einheitlichen Rechtsrahmen bekommen. Was das Parlament fordert und worauf es bei der Regulierung von KI ankommt, haben wir in diesem Artikel zusammengestellt.

Die KI-Verordnung als einheitlicher Rechtsrahmen

https://artificialintelligenceact.eu/ : „Worum gehts eigentlich beim AI Act? Bei dem Gesetz über Künstliche Intelligenz (häufig auch KI-Verordnung oder eben AI Act) handelt es sich um ein Gesetzesvorhaben der Europäischen Kommission zur Regulierung von Künstlicher Intelligenz. Es gilt als weltweit erstes vollumfassendes Regelwerk für Künstliche Intelligenz und könnte maßgeblich die Entwicklung und den Einsatz von KI beeinflussen“

Das weitere Vorgehen und Kontrolle von Algorithmen

Am 18.04.2023 ging offiziell das Europäische Zentrum für die Transparenz von Algorithmen (ECAT) in Betrieb. Das in Sevilla angesiedelte Zentrum verfolgt den Zweck, die von Unternehmen eingesetzten Algorithmen zu überprüfen und dessen Programmroutinen genauer zu erfassen. Grundlage dieser Überprüfung ist der Digital Services Act (DSA), der insbesondere großen Plattformen wie Google, Meta und Amazon einen einheitlichen Rechtsrahmen verleiht und über dessen Inhalte und Ziele wir bereits im vergangenen Jahr ausführlich berichtet haben. Die Inbetriebnahme des ECAT zeigt beispielhaft, dass die Europäische Union an vielen verschiedenen Stellen ansetzt, um die Digitalisierung effektiv mit Ordnungsrahmen zu flankieren.

Am 18.04.2023 ging offiziell das Europäische Zentrum für die Transparenz von Algorithmen (ECAT) in Betrieb. Das in Sevilla angesiedelte Zentrum verfolgt den Zweck, die von Unternehmen eingesetzten Algorithmen zu überprüfen und dessen Programmroutinen genauer zu erfassen. Grundlage dieser Überprüfung ist der Digital Services Act (DSA), der insbesondere großen Plattformen wie Google, Meta und Amazon einen einheitlichen Rechtsrahmen verleiht und über dessen Inhalte und Ziele wir bereits im vergangenen Jahr ausführlich berichtet haben. Die Inbetriebnahme des ECAT zeigt beispielhaft, dass die Europäische Union an vielen verschiedenen Stellen ansetzt, um die Digitalisierung effektiv mit Ordnungsrahmen zu flankieren.

Das europäische Gesetzgebungsverfahren zur KI-Verordnung befindet sich derweil in den letzten Zügen. Sobald sich das Europäische Parlament auf eine gemeinsame Position verständigt hat – anvisiert ist gegenwärtig der 26. April 2023 –, geht es in die finale Abstimmung des Gesetzestextes unter Mitwirkung des Parlaments, der EU-Kommission und der Rates der Europäischen Union (Trilogverhandlungen). Die Verordnung könnte damit noch in diesem Jahr in Kraft treten. Gemäß Art. 85 der KI-Verordnung wird sie dann 24 Monate später gelten.

KI-Verordnung als Schlüsselinstrument eines digitalen Europas

Zusammenfassend lässt sich festhalten, dass es sich bei der KI-Verordnung um „ein dickes Brett“ handelt. Angesichts der Tatsache, dass Künstliche Intelligenz ein maßgeblicher Fakor für unser zukünftiges Zusammenleben sein wird, ist eine europäische Harmonisierung folgerichtig. Enthalten sind dabei risikobasierte Kategorisierungen, in die sich die Künstlichen Intelligenzen einordnen lassen. Gewisse KI’s werden in der Folge verboten oder mit zusätzlichen Auflagen versehen. Ähnlich wie die DSGVO ahndet die KI-Verordnung rechtswidriges Verhalten mit empfindlichen Geldbußen.

Kanada ermittelt gegen Unternehmen hinter ChatGPT

Der kanadische Datenschutzbeauftragte untersucht, ob OpenAI unerlaubt persönliche Daten sammelt. Auch US-Präsident Joe Biden fordert, dass KI-Produkte sicher sein müssen. Der Schritt des kanadischen Datenschutzbeauftragten kommt vor dem Hintergrund wachsender Forderungen nach mehr Kontrolle bei KI-gestützten Technologien. In der vergangenen Woche hatten Technologie-Milliardär Elon Musk und zahlreiche Experten eine Pause bei der Entwicklung von besonders fortgeschrittener KI gefordert. Am Freitag sperrte Italien als erstes westliches Land ChatGPT vorerst aus Datenschutzgründen.

Biden: Unternehmen müssen auf Sicherheit von KI-Produkten achten

USA beraten über ChatGPT und die Nationale Sicherheit

Auch US-Präsident Joe Biden rief Unternehmen, die im Bereich der künstlichen Intelligenz arbeiten, dazu auf, die Sicherheit ihrer Produkte zu gewährleisten. Es müsse sich indes erst noch zeigen, ob künstliche Intelligenz (KI) gefährlich sei, sagte er. Biden traf am Dienstag mit seinem Rat für die Bereiche Wissenschaft und Technologie zusammen, um über Risiken und Möglichkeiten zu sprechen, die der rasche Fortschritt im Bereich der KI für einzelne Nutzer und die nationale Sicherheit bedeutet.

Wird der Einsatz von ChatGPT Arbeitsplätze kosten?

Sehen Sie sich unter https://www.fotocommunity.de/digiart/ki-generierte-bilder/21332 digitale Kunstwerke an und überlegen Sie ob nicht doch der ein oder andere Grafiker, Designer oder Fotokünstler eine mächtige künstliche Konkurrenz am Markt hat.

Eine Fortsetzung dieser Zusammenfassung folgt sicher. Denn diese Entwicklung wurde frei gesetzt und ist nicht mehr zu stoppen. Deshalb muss man sich damit auseinandersetzen. (hu) ++ende++

Quellen:

https://www.dr-datenschutz.de/neues-aus-dem-eu-parlament-zum-ai-act/

https://www.dr-datenschutz.de/chatgpt-verbot-und-datenschutzrechtliche-ersteinschaetzung/

https://www.5min.at/202304644088/wird-chatgpt-auf-schulen-bald-verboten/

https://www.dr-datenschutz.de/chatgpt-deutsche-datenschutzbehoerden-werden-aktiv/

https://www.diepresse.com/6229429/wie-die-ukraine-ihre-daten-vor-russland-in-sicherheit-bringt

https://www.wienerzeitung.at/startseite/archiv/95851_25-Jahre-Hochsicherheits-Bunker.html

https://techukraine.org/2022/06/03/palantir-to-open-an-office-in-ukraine/

https://www.trendingtopics.eu/palantir-corona-krise/

https://darwins-circle.com/conferences

Für alle betroffenen Firmen, Institutionen, Personen und überhaupt „Jeden und Alles“ gilt die Unschuldsvermutung. (hu) ++ende++

|

Herbert Unger – freier Journalist bei bkftv.at herbert.unger@bkftv.at oder 06645344908 Meine Artikel: https://bkftv.at/author/hu/ Schreiben Sie mir zum Thema Vertrauliche Kommunikation über: Threema ID hcclnoname: WUU3ZJJV Signal-Messenger oder persönliche Treffen: Face-to-Face |